По всем вопросам обращайтесь на: info@litportal.ru

(©) 2003-2024.

✖

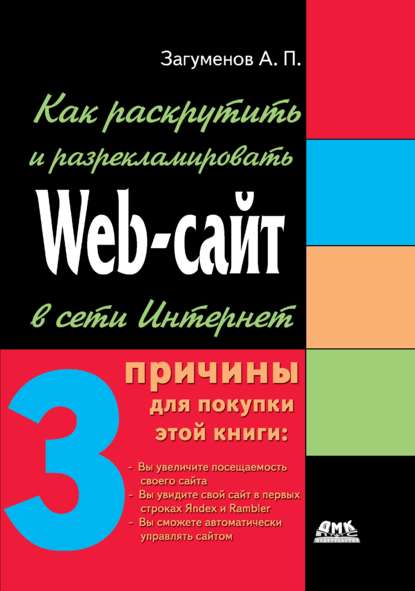

Как раскрутить и разрекламировать Web-сайт в сети Интернет

Настройки чтения

Размер шрифта

Высота строк

Поля

На одном сайте может быть только один файл robots.txt. Не следует помещать файлы с данным именем в каталоги, поскольку робот их не найдет. Обратите внимание, что при адресации в Internet учитывается регистр, поэтому название robots.txt должно быть задано в нижнем регистре.

Файл robots.txt – это обычный текстовый документ, содержащий одну или несколько записей, разделенных пустыми строками, как показано в следующем примере:

# robots.txt for http://www.mysite.ru (http://www.mysite.ru/)

User-agent: *

Disallow: /cgi-bin/maillist/

Disallow: /tmp/

Disallow: /product1.html

User-agent: aport

User-agent: scooter

Disallow:

Вот пример файла robots.txt, полностью запрещающего доступ к сайту всем роботам:

User-agent: * # Применяется ко всем роботам.

Disallow: / # Запретить индексацию всех страниц.

Каждая запись должна начинаться с указания переменной User-agent отдельной строкой. Таких строк может быть и несколько. Значением переменной User-agent задается оригинальное имя программы-робота соответствующей поисковой системы, для которой предназначена информация.

Согласно спецификации на файл robots.txt, текст в нем чувствителен к регистру, так что следует записать именно User-agent, а не User-Agent. Трудно сказать, вызывает ли неверное написание проблемы у роботов поисковых систем, но для надежности лучше соблюсти требования спецификации.

Имя робота может быть похоже на название соответствующей поисковой системы, а может и сильно отличаться от него. Далеко не всегда оно соответствует названию механизма поиска. Поэтому нельзя просто написать AltaVista в Useragent и ожидать, что AltaVista исключит указанные вами страницы. Имя робота указывается без учета регистра и не включает информацию о версии. Можно перечислить несколько имен через пробел. Символ * является маской и означает: «для всех роботов». В этом случае запись описывает режим доступа по умолчанию для любого робота, неупомянутого явно в других записях. В файле robots.txt не может быть нескольких таких записей.

В табл. 1 приведены имена роботов некоторых поисковых систем.

Таблица 1. Имена роботов поисковых систем

Начиная со следующей строки после указания переменной User-agent, определяются собственно правила поведения робота в виде задания значений переменным Allow (Разрешить) и Disallow (Запретить).

В поле Allow задается перечень разрешенных для посещения роботами поисковых машин каталогов и файлов, а в поле Disallow – перечень закрываемых каталогов и файлов. Это может быть полный или частичный путь. Любой URL-адрес, начинающийся с этого значения, нельзя будет загрузить. Например, запись Disallow: /help запрещает доступ к /help.html и /help/index.html, в то время как запись Disallow: /help/ запретит доступ к /help/index.html, но разрешит доступ к /help.html.

Если файл находится в корневом каталоге, обязательно включите перед его именем символ «слеш» – косую черту вправо.

Пустое значение параметра Disallow означает, что все URL сайта могут быть проиндексированы. Частая ошибка при написании robots.txt состоит в том, автор ставит *, чтобы указать, что хочет исключить все файлы в каталоге. Однако правильным будет не включать никаких звездочек в поле Disallow.

В файле robots.txt должно быть, по крайней мере, одно поле Disallow. Символ # предваряет комментарии, необрабатываемые роботами.

В примере, рассмотренном выше, первая запись запрещает индексирование двух каталогов и файла product1.html. Роботу Scooter поисковой системы AltaVista и роботу Aport поисковой системы Апорт для доступа открываются все каталоги (поле Disallow пусто). При необходимости закрыть все каталоги следовало бы написать: Disallow: /. Пустая строка между записями необходима.

Очень важно не допускать ошибок в файле robots.txt. В противном случае конструкции могут не работать, а вы даже не будете знать об этом. Возможно, некоторые поисковые системы без затруднений разрешат проблемы, возникающие из-за различий в синтаксисе, однако абсолютной гарантии нет. Поэтому, если вы обнаружите ошибку в синтаксисе, исправьте ее и повторно зарегистрируйте ресурс в поисковых системах. Роботы поисковых машин снова проиндексируют ваш сайт и выполнят все указания, имеющиеся в файле robots.txt.

Обратите внимание, что недопустимы строки вида:

Disallow: /tmp/*

или

Disallow: *.gif

Подробное описание стандарта исключений и синтаксиса команд файла robots.txt вместе с другой полезной информацией о роботах (на английском языке) можно найти по адресу http://www.robotstxt.org/wc/robots.html (http://www.robotstxt.org/wc/robots.html).

Тэг META для роботов

Файл robots.txt поддерживается практически всеми роботами, однако корневой каталог сервера может быть недоступен вам. В этом случае для аналогичных целей, но лишь в пределах одного документа можно использовать специальные метатэги. Они не только решают проблему запрета, но и предоставляют позитивные возможности для управления индексированием. Это более гибкое средство управления индексацией, чем robots.txt. В частности, в тэге можно дать роботу поисковой машины предписание не уходить по ссылкам на чужие серверы, например, в документах со списками ссылок:

<META NAME="robots" C0NTENT="index, follow">

Из данного примера видно, что все управление в метатэге сводится к указанию двух переменных, а именно NAME и C0NTENT. Для переменной C0NTENT в контексте NAME="robots" допустимо использовать следующие значения (они могут быть записаны как строчными, так и прописными буквами):

• index – разрешено индексировать документ;

• follow – разрешено следовать по ссылкам;

• all – эквивалентно употреблению index и follow одновременно (записывается через запятую), то есть разрешено индексировать данную страницу и все ссылки, исходящие из нее. Когда обнаружено слово all, все другие слова, если они указаны, игнорируются;

• noindex – не индексировать сам документ, но следовать по его ссылкам;

• nofollow – индексировать, но не идти по ссылкам;

• none – эквивалентно одновременному употреблению noindex и nofollow через запятую, то есть всем роботам предложено игнорировать данную страницу при индексации.

Если указанный метатэг пропущен или не задано значение переменной C0NTENT, то по умолчанию поисковый робот действует, как при значении C0NTENT="index,follow" (или C0NTENT="all", что равноценно).

Если в переменной C0NTENT содержатся противоположные по смыслу ключевые слова (например, follow и nofollow), то робот поступает по своему усмотрению; в данном случае выбрано follow).

В приведенном выше примере свойство NAME="robots" дает роботам предписание индексировать и саму страницу (C0NTENT="index"), и документы, ссылки на которые она содержит (C0NTENT="follow"). Вместо двух этих значений, приведенных через запятую, можно было бы написать одно – C0NTENT="all" – с тем же результатом.

Указанный метатэг позволяет авторам HTML-документов сообщать роботам о том, может ли документ быть проиндексирован или его следует использовать, чтобы получить дополнительные ссылки. Для этого не требуется вмешательства администратора сервера.

В следующем примере роботу не предписано ни индексировать сайт, ни анализировать ссылки:

<META NAME="robots" content="noindex, nofollow">

Другие метатэги

Другие метатэги также могут использоваться роботами при сканировании. Например, тэг с параметром NAME="author" позволяет ввести имя автора документа и учитывается некоторыми поисковыми системами, что иногда может существенно помочь при поиске.

Похожий метатэг с параметром NAME="generator" часто автоматически проставляется различными HTML-редакторами и содержит информацию о программе, в которой был сделан документ. Некоторые авторы в его описании дублируют информацию метатэга "author".

Метатэг с параметром NAME="copyright" служит для указания принадлежности авторских прав.